�����С����ҕ�l,��������������ˣ�

�P(gu��n)��AI����˼��֮��

�罻ƽ�_�؈D

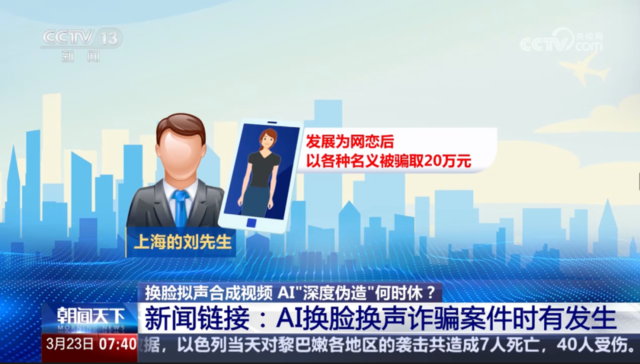

AI �p�_���S̎��Ҋ

�����AI���X,�������_�l(f��)�ˆTС·�J(r��n)�飬AI��ٸ�ֵ�þ���,���������˞�����AI����̓�ك�(n��i)���������p���О�,����

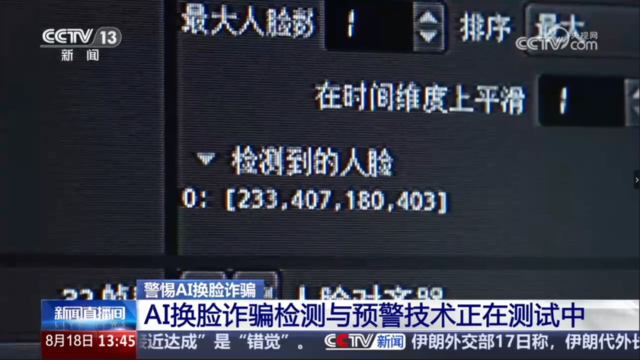

��(sh��)��,��AI�QĘ,��׃���p�_�¼��ѽ�(j��ng)��Ҋ���r��ֱ���g�AI�QĘ������Ժʿ�����ۼٴ���,�����ܼ����ƿ�����ˎ�����쯟Ч��,���㷨����(zh��n)���͡����θ�Ѫ�����_�֡���

2022����2024������Ї����l(f��)����AI �QĘ����p�_��������,����Ӌ(j��)�o����Ⱥ����ɽ�(j��ng)��(j��)�pʧ���_(d��)2�|Ԫ,��

AI�Ă��켼�g(sh��)��ͬ�����_��������Ժ�����ķ��ُ�һ��,�������ؓ(f��)؟(z��)��һ���ڄ��V�A������,���ڄ����ṩ���C��(j��)�ͱ����ɡ���AI��ٵĿ��ܡ���

���@��һ�����ˆ�λ�����ߵ����,������(n��i)�����P(gu��n)�ڏ�(qi��ng)�ƼӰಢ�ܽ^֧���Ӱ��M(f��i)��,�������ˆ�λ��ʾ��ԓ�����߲�δ�l(f��)���^�����Փ,���ڄ����ṩ�����������AI�ϳɵġ�,������һ���f,��

�DԴ��ҕ�X�Ї�

���@��������� ����ȫ�]���κΆ��},�����H�Z���Z�{(di��o)������Ҳ�� �������еđ�ŭ,�����ӵ���w,������һ���f,����Ŀǰ�ķ��ɷ�Ҏ(gu��)��δ���_Ҏ(gu��)�� AI �����C��(j��)�����|(zh��),��Ч�����J(r��n)����(bi��o)��(zh��n)���@ʹ�����Д� AI �����C��(j��)�ĺϷ��ԕr(sh��),��ȱ�����_�ķ�������(j��),����